さっそくですが、VRゴーグルで全天球型写真(360°パノラマ写真)のバーチャルツアーを見ると、良い感じなのですが、何かちょっと見え方が違うような気がします。

(あ・・・、普段、VRゴーグルの視聴をされていない方々-圧倒数-には十分な見え方だと思います)

なぜ、VRゴーグルだと不自然な感じになるの?

なぜ、VRゴーグル視聴になると、ちょっと見え方が不自然になるかといいますと、〝左右の視差〟を感じられないことが挙げられると思います。

リアルに感じられる奥行き感が0%なんですよね。

そもそも、普通の写真と同じで奥行のデーターは持っていません・・・ので。

VRゴーグルで不自然に見えないパターン

3Dにする(360°じゃない場合)

ほぼほぼ、この方法です。例えば、ゲームなどでは3Dの空間を作っている分けですね。

現実の空間を3D化するのは、フォトグラメトリなどの撮影を行い空間自体を専用のソフトウェアで制作したり、流行りのAIで作らせたりする必要があります。

360°の場合は、対応しているソフトウェアや6面体に分解して制作する方法があるそうです。

(試したことはありませんー)

ただし、現実世界の空間を3Dにすると膨大なデータになるので細かいデーターは削減する必要が出てくると思います・・・

よくお話させて頂くのですが「臨場感」は強いのですが「リアル感」は薄れてしまうかなーと思います。

360°の場合

〝ツールでネチネチ〟と線を引いて行くような感じで作る方法があります。

正直、めちゃくちゃ、面倒臭いです。

この方法で作る視差を出すデーターは、上と同じようなデーターの種類となります。

数字の羅列です。。。

もう一つの方法に、同時に視差のデーターを残せる専用のカメラを使う方法があります。

ただねー、それなりにお高いワンショット型のカメラなんですよね。

VRゴーグルでは、まずまずなのですが、パソコンやスマートフォンで見ると綺麗感は薄い感じがしています。

最後は、ライダーというiPhoneのカメラなどにも付いている奥行を取り込めるデーターを使うような撮影機材もあります。

桁が違いますが、精密なデーターが残せるので土木系・建設系には向いているかもと思います。

単純な360°写真だけだと、「リアル感」は強いのですが「臨場感」は薄れてしまうかなーと思います。

ただし、現実世界を見せたい場合、今の処、最もいい感じで、コストも抑えられる方法です。

こちらもワンショットなのですが、こちらは、カメラで視差をマルっと撮るものです。(360°が2っ)スト

今回、試してみたいこと!

ちなみに、僕が撮影に入る現場でフォトグラメトリなんて・・・

100%無理なことが多いのです?

できるとすれば、新築住宅のお家なのですが納品用の360°写真をはじめ、スチール写真を含めていると、フォトグラメトリなんて時間がないかなーと思います。

リビング+周辺だけとかなら・・・ですね。

十分な検証ができていませんので、商品として販売できる状態ではありません。

一発で綺麗に決めるデーターを撮らないと・・・という感じなので、先かなと。

ただ、360°写真を元に、視差のデーターを起こすことができればと思いました。

ちなみに、既に、ネットには写真から3Dデーターにできるサイトなどがあります。

スチール写真なら、まぁ、良い感じっぽく仕上がるのですが、何だかなー

VRゴーグルかけて、空間ビデオならOKですが空間写真はちょっとインパクトに欠けるかもですね。

試しに、360°写真で視差を出せるファイルを吐き出しました。

うーん?仕事では無理なのですが、サービス的なオマケなら使えるような気もします。。。

ちょっと、NGな部分があったり、何か違う感じがあったりしますが試したデーターが悪かったのかもしれません。

ただ、残念ながら無料の範囲で〝商用利用〟がNGなようです。。。

➔ これは、割と多いですよね!(販売価格が0円なら良いのかな・・・?)

さー、どうすべか・・・?

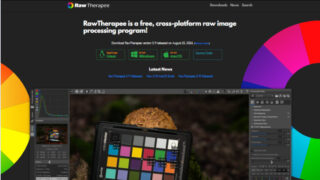

と、いろいろと、調べていると先人様が様々な方法をネットに書いて教えてくれています。

お題の通り、ローカル処理のAIなら商用利用を問わないソフトウェア?プログラム?があるようです。

これは・・・試してみるしかない!

ここまでが、今のところの動きです・・・

さてさて、なぜ、こんな無謀なことを試すに至ったかと申しますと・・・

マイクロソフトの罠に引っかかってしまったからです。

orz・・・

トラブルが多いと噂のWin11 24H2。

はい。僕のパソコンにもダウンロード完了していまして、ず~~~と止めていたんですよねー

昨日、見たことがないバルーン(下からのポップアップ)が出ていまして、その前の日に、アップデートがかかっていたので、緊急の修整で何かあったのかなーっと、うっかり〝Yes〟を押してしまいました・・・?

やってもうた・・・?

すこぶる調子よく使っていた作業用PCだったのにな・・・

悪魔のASUSなので不具合が近づいて来そうで怖いです。

24H2が入ってしまったので、ある意味、踏ん切りがつきました。

もう、python再インストールして、いろいろ試すのも怖くない!

数枚を試しましたが、ネット上の生成と比較をすると視差に必要な分解度度が半分くらいなイメージです。

そろそろ、視差を表現できることを深度マップ(Depth Map)と書きましょうかー

基本的に、手前は白色(明るく)、奥は黒色(暗く)になるファイルです。

ちなみに、PhotoshopでもDavinciでも深度マップを生成できるのですが、ぶっちゃけ、全く使い物にならない分解状態でした・・・

これには、正直、ガッカリしまくりです。

ちなみに、空間の中を歩けるのですが歩く先の映像がありませんので、変にグニャリと曲がったようになってしまいます。

3Dデーターとは異なり、歩くことが前提になる表現ではありません。

ただ、お試しデーターをVRゴーグルで見ると家具や椅子、目の前に迫る土手とか、割と臨場感を感じることができるようです。

この生成AIは、もちろん、360°写真のサポートは無いのですが・・・

今までの360°写真を使ったVRゴーグル視聴で、今までとは違う、ちょっと臨場感を追加できたら素敵だなーっと思っています。

今日もブログのご拝読、ありがとうございます。

追伸:

24H2ですが、適用後、何から何まで動きが重くなりました・・・

しばらく使っていると、よく利用するものについては、同じくらい?

たまに使うものは、やっぱり重いという感じです・・・

コメント